作者 | 西安电子科技大学 邵晓鹏

当微信朋友给你发了一张感兴趣的照片时,你会不自觉地用两只手指做放大动作,看得不过瘾时,恨不得按住屏幕使劲放大、放大、放大……可是这些照片总有一个放大的限度。

在看到的大片中,经常会看到间谍卫星跟踪一个嫌犯的场景,这些特工肆意放大卫星图像,再放大一点,嫌犯脸上的刺青都能看清楚。但,这是电影。

近几十年,超分辨率火得不了。图像处理领域的学者提出了一大堆超分辨率重建的算法,检索此类论文的容量估计能占满你的硬盘;成像领域的学者也不甘落后,设计出了大量的超分辨成像方法,更有超衍射极限的说法。可是,一旦提到超衍射极限,就马上有很多人站出来质问:“你说,什么是衍射极限?你怎么就超了衍射极限?”于是,辩论顿起,谁都有理,谁都不服谁……

曾几何时,你要是做了一个图像的超分辨率算法展示给光学专家看,大概率地会得到一个直射灵魂深处的眼神:你那是个假分辨率!聊天到此为止。

为什么会有这么多争议?分辨率是成像领域永恒的主题,各种超分辨率方法层出不穷。光学中有超分辨率的说法,图像处理里也有。本来各自相安无事,可是到了学科交叉的时候,这种井水不犯河水的格局即被打破,原先各表一方的说辞已收不住场,铺天盖地的超分辨率让很多人混淆了概念。其实在概念上本来是很简单的一件事,对图像而言,是超分辨率重建;对成像而言,是超分辨率成像。就因为一个超分辨率,相互不对付了。

那么,什么是分辨率呢?什么又是超分辨率?为什么可以超分辨率?又为什么要超分辨率呢?这似乎是一笔并不是那么清晰的账,本文将从物理的角度和信号处理的角度来解释超分辨率,明确到底是超了谁的分辨率,以及还有哪些手段可以超分辨率。

一、分辨率的定义

分辨率的英文为Resolution,翻开Merriam-Webster词典,其解释:“a measure of the sharpness of an image or of the fineness with which a device(such as a video display, printer, or scanner)can produce or record such an image usually expressed as the total number or density of pixels in the image.” Longman词典APP解释:“the power of a television, camara, microscope etc to give a clear picture.”从这两本经典的词典里,这个“分辨率”是一个泛指图像清晰程度或者图像输出设备解析能力的词,其实就是我们经常说的那个空间分辨率。

那马上就有人问了,那是不是还有其他的分辨率?当然,凡是能度量的量都存在分辨率,比如时间、空间、光谱、辐射量等等,都是成像中会遇到的分辨率。而我们常说的分辨率,没有特别限定的话就是指空间分辨率。

那什么是空间分辨率呢?空间分辨率简单讲就是单位长度内拥有多少个采样点,采样点越多,分辨率越高。举个例子:1 mm的长度采样1000点,那每个点就是1 μm,这时候我们就可以说其空间分辨率是1 μm。对于侦察卫星而言,经常会出现10 m、2 m、1 m、0.5 m甚至0.1 m的分辨率,就是指对地观测时的空间分辨率,对于0.1 m的精度来说,一辆汽车约有20×40像素。

聪明的读者马上就会想到:那么,提高采样频率,不就能提高空间分辨率了吗?其实,科技工作者就是这么做的,我们的手机像素数越来越高,像元越来越小,其实就是提高了采样频率。那问题马上又来了,是不是可以无限地靠增加采样频率提高空间分辨率呢?这时候,物理学家躲在旁边不怀好意地笑了:你知道衍射极限吗?而这里的故事有很多,超采样也在很多场合里有应用,尤其是在航天航空领域内红外成像系统,很多时候红外光学系统的弥散斑已超过了像元尺寸大小,这就是典型的超采样。

说到衍射极限,相信很多人脑子里都有一笔糊涂账,我在这里尝试着梳理一下艾里斑、阿贝极限和瑞利判据的关系吧。

二、衍射极限与分辨率

1835年,英国皇家天文学家乔治·比德尔·艾里(George Biddell Airy)是第一个明确给出衍射极限的科学家。他在一篇“On the Diffraction of an Object-glass with Circular Aperture”的论文中对圆孔衍射进行了理论解释。当点光源经过光学衍射受限系统(可以是透镜,也可以是一个圆形孔径)后,由于光波衍射的影响,所成的像不是一个理想的点,而是一个明暗相间的圆形光斑,其中以第一暗环为界限的中央亮斑称作艾里斑。我们现在都知道,根据傅里叶光学,这个著名的艾里斑其实可以对一个圆斑(其实就是圆形光阑)做傅里叶变换就能得到。

艾里在论文中给出了圆孔衍射的强度分布所满足的条件,特别的,当中央亮斑的强度第一次衰减至零时,即第一暗斑出现的位置,满足:s=2.76/r,其中s表示中央亮斑相对透镜孔径中心的最小张角,单位为角秒,r表示透镜的半径,单位为英寸,该式是以可见光波长的平均值560纳米或者0.000022英寸计算的。

1873年,德国物理学家恩斯特·阿贝(Ernst Abbe)发现了显微镜分辨率极限的公式,被叫做阿贝极限,定义为:

其中,是光波长,是样品与显微物镜之间介质的折射率,是显微物镜的孔径角,数值孔径,阿贝是定义数值孔径这一术语的首位科学家。

1896年,英国的瑞利男爵三世(原名:John William Strutt)以艾里的理论为基础,并做了进一步延伸,创造了“瑞利判据”理论(Rayleigh Criterion)。具体定义:

如果一个点光源的衍射图像的中央最亮处刚好与另一个点光源的衍射图像第一个最暗处相重合,认为这两个点光源恰好能被这一光学仪器所分辨。瑞利判据是第一个明确给出了光学仪器分辨本领的准则。在此准则下,两点光源对透镜中心的张角称为该光学仪器的最小分辨角,单位为弧度,定义为:

其中,是光波长,D是透镜的直径。将艾里的理论推导结果与瑞利判据的公式相比较,经过单位归一化后,两者得出的艾里斑角半径完全一样。因此,为了叙述方便,现在多以瑞利判据给出的最小分辨角公式作为艾里斑的角半径。

是不是有点乱?确实,很多人分不太清楚阿贝极限和瑞利判据到底有什么区别。

瑞利判据给出的光学仪器的分辨本领是以角分辨率来定义的,但是在实际成像系统中,我们更关心物体的空间分辨率,或者叫线分辨率,用单位长度可分辨的多少个线对来表示

再深入一点点。我们看图中表示透镜最小可分辨的物方空间两点的距离,为像方两点对应的艾里斑的中心间距,和分别表示物方和像方的透镜孔径角,D为透镜的直径,和分别为物方空间和像方空间的折射率。

在傍轴条件下,假设很小,则有,根据瑞利判据:

对于显微镜系统来说,系统设计应满足Abbe正弦条件,即电脑,又因为显微镜的像方通常为空气,所以

其中,,就是由阿贝定义的数值孔径。

我们来做个比较:根据瑞利判据得出的显微镜分辨率公式为,而阿贝给出的显微镜分辨率为

,两者大致相当。这也就是我们经常会看到不同的论文给出的公式,前面的那个系数怎么还会变?!

我们来看一个典型的例子:对于天文望远镜系统来说,

由物像关系式可知,天文望远镜的空间分辨率为:

,其中表示物距,对于天基望远镜来说,其实就是卫星距离地面目标的距离。从这个公式中很明显能看出来:空间分辨率受口径D的限制,口径越大,分辨率越高。这也就是为什么我们要做大口径望远镜的原因。

其实,对于人眼或者手机、单反相机等缩小系统,也可以用上式作为最高空间分辨率的计算公式,也就是说:瑞利判据基本上可以作为目前各类光学仪器的分辨率计算准则。

三、超分辨率与超衍射极限

那么,超分辨率(Super-resolution)是个什么东西?从字面上来看,就是超越了之前的分辨率。那问题又来了,之前那个分辨率是啥?你说的这个超分辨率与超衍射极限到底是什么关系?

我们先从光学的角度来看这个问题吧。每个学过物理的人都应该知道衍射极限的存在,当然如果你去问很多学过大学物理的老师和学生,他们并不一定记得。“好”学生会牢记衍射极限的存在,而科学家“No Zuo No Die”之精神可不认这个邪,挑战权威是他们典型的思维模式?“什么?衍射极限?!超之!”于是乎,轰轰烈烈的超衍射极限成像技术就拉开了大幕,一拨又一拨的超衍射极限成像方法涌现。

在显微领域里,典型的超衍射极限成像技术主要分为三大类:结构光照明显微成像技术(Structured illumination microscopy,SIM)、受激发射损耗显微成像技术(Stimulated emission depletion,STED)以及单分子定位显微成像技术(Single molecule localization microscopy,SMLM)。

1)SIM——频率“搬运工”

任何一个光学系统可以看作为一个低通滤波器,其可通过的空间频率带宽由物镜的数值孔径决定,高于这一空间频率的信息都不可以通过。SIM利用特定结构的照明光,在成像过程中把位于物镜收集能力范围之外的一部分高频信息“搬运”到低频区域,也可以理解为将高频结构信息编码至低频的图像中,在成像系统捕捉到样品原有的低频信息和经过“搬运”后的高频信息之后,再利用特定算法将范围内的高频信息“还原”到原始位置,从而扩展通过显微镜系统的样品频域信息,使得重构图像的分辨率超越衍射极限的限制,利用SIM的方法可以提升原有荧光成像系统的分辨率2倍。

2)STED——套在光上的“紧箍咒”

点扩散函数描述了成像系统对点光源的响应,如果能够使光学系统的点扩散函数尽可能的接近或成为一个理想的点,则可以使光学系统突破衍射极限。STED基本原理是采用两束激光同时照射样品,其中一束激光用来激发荧光分子,使物镜焦点艾里斑范围内的荧光分子处于激发态。另一束光为损耗光,可以使物镜焦点艾里斑边沿区域处于激发态的荧光分子通过受激辐射损耗过程返回基态而不自发辐射荧光,因此只有中心区域的荧光分子可自发荧光辐射,从而获得超衍射极限的荧光发光点。简单来说,激发光的作用是将荧光分子激活,而损耗光的作用是将荧光猝灭。这种方法通过物理手段减小点扩散函数,使用特殊的荧光材料,是一种直接成像方法,无需后期处理过程,成像结果可靠。但想获得较高的分辨率,就需要以牺牲成像速度和成像视场为代价。该技术的发明者德国马克斯普朗克生化研究所教授Stefan W.Hell获得了2014年诺贝尔化学奖。

3)SMLM——“纠纷”调解者

两个挨得很近的光点会让我们分辨不出谁是谁,那么如果我们分开来看呢?也就是说,当我们照射并观察第一个点时,第二个点并不会发光,自然不会产生艾里斑影响我们观察第一个点,前者艾里斑的中心点位置就是荧光分子的准确位置。接下来,通过某种方法,让第二个点被照亮。这个时候第一个点又不在光斑的照明范围之内了,同样不会干扰对第二个点的观察。通过这种“以时间换空间”的设计,巧妙地绕开了阿贝极限的束缚,将光学显微镜的分辨率大大提高。这类超分辨率方法统称为单分子定位显微术,代表性工作包括光激活局域定位显微成像技术(Photo-activation localization microscopy,PALM)以及由华人科学家庄小威院士发明的随机光学重构显微成像技术(Stochastic optical reconstruction microscopy,STORM),其中PALM的发明者美国霍华德休斯医学研究所教授Eric Betzig以及美国斯坦福大学教授William Moerner也共享了2014年的诺贝尔化学奖。

超衍射极限方法就这么多了吗?多着呢!我们接着看精彩纷呈的光学超分辨率战场。

4)傅里叶叠层显微(FPM)——多维光场信息应用的开拓者

上面的几种超分辨率显微成像技术主要关注点在于“Push”分辨率的极限,主要应用场景也是针对生命科学中对极微小物体的观察,其实是牺牲了时间和视场换来的。就光学显微镜系统来说,视场与分辨率是一对此消彼长的矛盾。在显微镜的常规使用中,为了在不牺牲视场的情况下,获取相对更高的分辨率成像效果,也是科学家比较关注的问题。傅里叶叠层显微(Fourier Ptychographic Microscopy,FPM)是一种典型的计算超分辨率显微成像技术,采用可编程LED阵列提供空间不同角度的照明,不同入射角度光波照射同一样本可以携带样本的不同空间频率成分,依次采集不同角度照明的低分辨率图像之后,将低分辨率图像在频域中进行相位恢复和孔径合成,实现大视场、高空间分辨率的成像效果。这种将样本高频信息编码至低频的图像中通过光学系统,然后进行孔径合成实现频谱扩展的思想与SIM也很相似。

5)基于探测倏逝波的近场超分辨率显微

近场指的是物体表面小于一个波长(或λ/2)尺度范围内的区域,其核心问题是对于倏逝波的探测。倏逝波沿着界平面平行的方向会产生光波,其电场及磁场的复振幅随着远离临界面距离的增大而呈现指数级的减小趋势。倏逝波来自于物体中的细微结构,近场显微镜的成像原理即通过探针扰动物体表面的局域倏逝波,探针所获得的信息能够反映样品精细结构的局部变化,用探针进行样品表面扫描,就可以得到样品的图像。成像的分辨率取决于探针尖端小孔的直径和样品的间距。近场显微成像技术的典型应用为电子显微镜,具体包括扫描隧道显微镜、原子力显微镜等,2021年,康奈尔大学的陈震利用叠层技术与电子显微镜结合实现了0.02 nm的超高分辨率。

6)基于合成孔径实现超分辨率成像

我们先来看一下合成孔径的概念。在光学仪器中,孔径是指物镜的直径,它的大小决定收集光能量的能力。雷达波是经过天线辐射出去和接收进来的,天线就相当于光学仪器的物镜,孔径越大,辐射和接收的雷达波能量越大,雷达的作用距离越远、分辨率越高。但在很多场合,例如在飞机或卫星上,雷达天线不可能做得很大,探测目标的距离和分辨率因此受到限制。利用雷达与目标的相对运动,把雷达在不同位置接收到的目标回波信号进行信号处理,可以使小孔径天线起到大孔径天线的效果,获得很高的目标方位分辨率,这就是合成孔径的含义。

合成孔径雷达(Synthetic Aperture Radar,SAR),是利用合成孔径原理,实现高分辨率的微波成像,具备全天时、全天候、高分辨、大幅宽等多种特点。

扩大光学系统口径是提高分辨率的重要途径。但是,随着口径的增大,工程制造难度和制造成本呈指数级增长。因此,为解决单体大口径制造困难的问题,国际上先后发展了斐索像面干涉型和迈克尔逊干涉型两种合成孔径成像技术。光学合成孔径,就是通过一系列易于制造的小孔径系统组合拼接成大孔径光学系统以实现大孔径系统的高分辨率要求。目前,美国的詹姆斯韦伯空间天文望远镜就是采用主镜拼接技术,采用18块子镜拼接成6.5米口径的主镜。我国的中国科学院国家天文台研制的郭守敬望远镜也是采用同样的子镜拼接技术。由于光学系统成像必须满足几何光学的等光程条件和物理光学的共相位条件,因此合成孔径成像技术对位相控制的精度要求非常高,通常在十分之一个波长内。

另外,FPM其实就是利用了合成孔径的思想,并结合了叠层相位恢复技术实现的超分辨率成像。

7)基于微纳光学的超分辨率成像

i)超透镜:

超表面是一种二维超材料,是由大量亚波长单元在二维平面上周期或非周期排布而构成的人工结构阵列,能够对电磁波进行灵活操控。超透镜是利用超表面实现的一种二维平面透镜结构,其体积极小,重量轻,易于集成,可实现对入射光振幅、相位、偏振等参量的灵活调控。利用超透镜可以实现超分辨率成像,下面介绍三种超透镜。

第一种是远场超透镜,由一块带有周期性凹槽波纹的超透镜构成,将远场超透镜放在物体附近,能显著增强物体发散出的倏逝波,被放大后的倏逝分量进而被周期性凹槽光栅转换为传播波,从而可在远场收集物体的高频空间信息重建并得到突破衍射极限的图像。

第二种是双曲超透镜,双曲超透镜由具有双曲色散特性或椭圆色散特性的各向异性材料弯曲后构成,利用双曲超透镜可以将近场的像直接放大到远场,能实现远场超分辨率成像和放大成像的效果,主要原因在于倏逝波能在此材料中传播并能实现倏逝波到传播波的转换。

第三种是负折射超透镜,负折射材料的超透镜可增强呈指数衰减的倏逝波,获得倏逝波携带的细节信息,突破衍射极限,实现高分辨率成像。

ii)表面等离子基元:

表面等离子激元(Surface Plasmon Polaritons,SPPs)是一种沿着介质和导体界平面方向传播的电磁波,当光入射到金属-介电界面时,金属表面的自由电子发生集体振荡,电磁波与金属表面自由电子耦合而形成的一种沿着金属表面传播的近场电磁波。为了提高光学成像的空间分辨率,就必须要探测到由样品衍射的大波矢分量,即倏逝波。它们会随着与物体远离而迅速衰减,从而导致远场光学仪器的分辨率受到衍射的限制。表面等离子激元使电磁场被限制在远小于光波长的横截面内,因而可以突破光的衍射极限。

(8)超采样极限分辨率成像

现在的成像系统都采用CCD或者CMOS数字传感器,其像元尺寸的大小代表成像系统空间采样的频率,根据奈奎斯特采样定理,采样频率至少大于等于信号频率的2倍才可以完整记录信号,这意味着如果在传感器前面不加任何光学放大系统,像元尺寸的大小要小于目标最小尺度的二分之一才可以不丢失目标信息进行完整记录。无透镜显微成像技术最大的特点是物体与传感器之间不需要任何成像光学元件,因此也不存在任何光学像差,可以获得与传感器感光面面积相等的视场范围,近年来也是大视场、高分辨率显微成像的热门研究领域。由于无透镜成像系统的采样频率直接决定于像元尺寸的大小,但是,随着传感器像元尺寸的减小,受到散粒噪声影响从而导致图像质量严重下降。因此,像元尺寸的大小不能无限减小。目前用于成像系统最小的传感器像元大概在1 μm左右,对于观察亚微米尺度的物体明显采样频率不足。针对由像元尺寸大小的限制导致成像系统空间采样不足而引起分辨率受限的问题,科学家们也提出了相应的超分辨率成像方法,最典型的莫过于亚像素位移超分辨率成像技术。

当采集的低分辨率图像间有整像素位移时,不同的低分辨率图像在相同采样点上的信息没有任何差异,无法用于超分辨率重建。而当低分辨率图像之间存在亚像素位移的情况下,每一幅低分辨率图像都无法由其他图像经简单变换得到,这样每一幅低分辨率图像间都含有相似又互补的信息,超分辨率重建就将这些新信息都融合到一幅图像中,从而得到高分辨率图像。通常的做法是将传感器固定在一个精密的平移台上,通过传感器的相对运动采集序列图像来获取低分辨率冗余信息,最后通过图像的配准算法进行图像超分辨率重建。利用该技术实现对亚微米物体大视场、高分辨率观测的成像技术有美国加州理工学院Changhuei Yang教授课题组提出的亚像素移动投影显微成像技术(Subpixel perspective sweeping microscopy, SPSM),美国加州大学洛杉矶分校的Aydogan Ozcan教授课题组提出的无透镜数字同轴全息显微成像技术(Lensless digital in-line holographic microscopy, LDIHM)以及美国康涅狄格大学郑国安教授课题组提出的编码叠层显微成像技术(Coded Ptychographic Microscopy,CPM)。

以上是对各种超衍射极限方法做了简单的介绍,那么我们看,这些方法是不是真的超越了“衍射极限”?这是个问题!其实这个问题很简单:这些方法实际上超的是超分辨之前系统的衍射极限,引入的新的单元构成的新系统又产生了新的衍射极限。不信,你把这些问题逐一捋一捋,比如FPM实际上是引入了光照的数值孔径,新系统的数值孔径为原光学系统的数值孔径与光源数值孔径之和。

四、图像超分辨率重建

图像超分辨率重建旨在从给定的低分辨率图像中,重建出含有清晰细节特征的高分辨率图像,是计算机视觉和图像处理领域中的一项重点研究任务。超分辨率重建技术就是实现现有图像在分辨率上的“超越”。不同于对图像进行复原、去噪等仅仅恢复图像清晰度的处理方法,超分辨率重建技术更趋向于增强图像的细化识别能力,减小单个像素的信息含量。低分辨率图像在经过超分辨率重建后得到高分辨率图像,对于图像中同一目标物体的表现,高分辨率图像所需的像素个数高于低分辨率图像,相应的高分辨率图像单个像素的信息含量比低分辨率图像低,但图像的细节表现能力却更高。十几年前,超分辨率重建还是很火的,有单帧的、多帧的、基于模型的、基于字典的、稀疏表示的……,诸多类型。现在流行的是深度学习超分辨率重建,效果不俗。

五、小结

提到超分辨率,我们总是想到空间尺度上的分辨能力。但从广义的概念上理解,光场函数所包含的时间、波长甚至偏振等信息都可以进行超分辨率。对于时间维度来讲,有超快成像;对于波长的维度来讲,有超分辨光谱仪技术。

2022年,Science提出了125个重大科学问题,其中一个就是“衍射极限到底存不存在”?我个人认为是存在的,而且只要有衍射,就会一直存在。目前为止,人类似乎只能看到有穷的事物,当然,爱因斯坦曾经说过:人类的愚蠢是无穷的。我也同意爱因斯坦的说法。对于超衍射极限而言,最应该明确的是衍射极限是与系统密切相关的,经过若干方法获得的超衍射极限后,其实会产生一个新的极限。其实,我更想要说的是,种种超分辨率方法其实都是提升光场信息维度后做了投影而得到的。说到底,光场作为计算成像技术的灵魂,在超分辨率成像领域中依然得到印证。今后,我们还会研究各种超分辨率方法,再聚焦一点,就是专注研究光场维度提升与分辨率的关系,建立起映射关系,也许有一天,你也会获得诺贝尔奖。

转载内容仅代表作者观点

不代表中科院物理所立场

如需转载请联系原公众号

文章原名:超分辨率,到底超了谁?| 邵晓鹏专栏?

来源:中国激光杂志社

编辑:Tammy

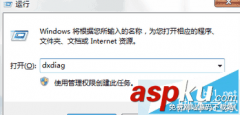

电脑

![RedHat服务器上[Errno 5] OSError: [Errno 2]的解决方法](https://img.pc-daily.com/uploads/allimg/4752/11135115c-0-lp.png)