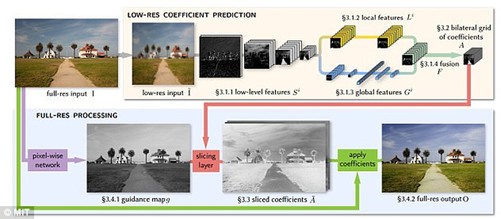

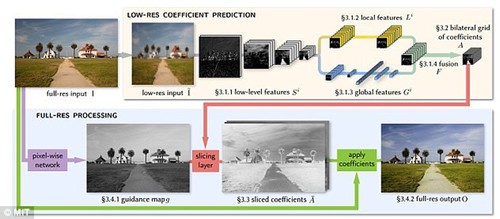

MIT与谷歌联合研发的图片处理系统(图片来自MIT)

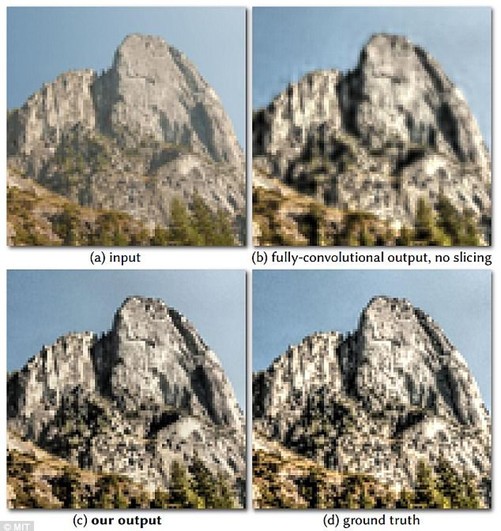

据悉,这套机器学习系统可以通过分析训练数据不断学习,让现有的图像处理算法加速运行。研究人员在测试中发现,新系统生成的图像与谷歌算法生成的图像很难区分,但所用的时间只有十分之一,速度足够快,完全可以实时显示。

MIT电子工程、计算机科学研究生迈克尔·加哈比表示:“谷歌听到了我们在做这样的研究,他们自己也跟着研究,我们将双方的方案整合在一起,要在云端处理一切,不断学习。学习的第一目标就是加快速度。”

这一系统始于早期的MIT项目(图片来自MIT)

这种系统不仅处理速度快,而且很节能,能够实时显示修饰图片,这样一来摄影师可以一边拍摄一边查看最终图像。每一次学习新任务时,都要用数千对图片进行训练,包括原始图片和润饰图片。

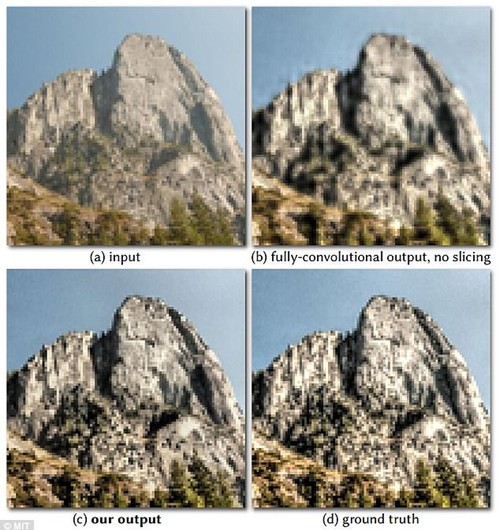

据了解,机器学习系统输出的结果不是图片,而是一组公式,可以对图片的像素色彩进行修改。在训练时,系统的性能如何由输出公式的表现决定。具体来说,研究系统输出的是3D网络,即16×16×8。网络16x16的一面对应原图像的像素位置,上面会堆叠共8层,对应不同的像素强度。每个网格单元都会有一个公式,决定如何对源图像的色彩数值进行修改。

通过应用特定图像处理算法,对海量图像进行训练(图片来自MIT)

该像素的色彩数值如何修改由方块四角的公式组合后决定,会根据距离判断。同样,网络的第三维也这是样判断的,也就是对应像素强度的那一面。

这项技术有助于移动平台上的实时图像增强(图片来自MIT)

研究人员会用Durand和Adobe的数据集训练系统,数据包括5000张图片,并且会将系统与其它机器学习系统对比,在处理过程中,全分辨率图片需要12GB的内存执行操作,而研究人员的新系统只要100MB左右,相当于1/100。

在本周举办的Siggraph会议上,麻省理工学院(MIT)计算机科学与AI实验室联合谷歌的研究人员展示了一套新系统,可以自动按照专业摄像师的处理方式修饰图片,并且可以在手机上运行。